英语原文共 4 页,剩余内容已隐藏,支付完成后下载完整资料

The INTERSPEECH 2010:副语言挑战

Bjouml;rn Schuller1, Stefan Steidl2, Anton Batliner2, Felix Burkhardt3,

Laurence Devillers1, Christian Muuml;ller4, Shrikanth Narayanan5

1CNRS-LIMSI, Spoken Language Processing Group, Orsay, France

2FAU Erlangen-Nuremberg, Pattern Recognition Lab, Germany

3Deutsche Telekom AG Laboratories, Berlin, Germany

4German Research Center for Artificial Intelligence (DFKI), Saarbruuml;cken, Germany

5University of Southern California, SAIL, Los Angeles, CA, USA

{schuller|devil}@limsi.fr, {batliner|steidl}@informatik.uni-erlangen.de,

Felix.Burkhardt@telekom.de, cmueller@dfki.de, shri@sipi.usc.edu

摘要

大多数副语言分析任务缺乏一致的评价程序和可比性,与语音分析中的“传统”学科形成鲜明对比。这篇文章通过解决三个选定的子挑战,将有助于克服通常结果的低兼容性。在年龄子挑战中,说话者依据年龄被分成了四组;在性别子挑战中,必须解决三级分类问题;最后情感子挑战中,要求说话者对顺序表示兴趣。本文介绍了现状、“aGender”和“TUM AVIC”语料库挑战以及可以使用的标准特征集。此外,还给出了基线结果。

索引词:副语言挑战、年龄、性别、情感

- 引言

与传统的语音分析学科相比,大部分副语言分析任务彼此相似,不仅表现在处理方法和始终存在的数据稀疏性,还表现在缺少一致的评价程序和可比性。同时,由于对人机通信、人机对话和多媒体检索领域的应用兴趣不断增长,它成为一个迅速兴起的研究领域。在这些方面,《The INTERSPEECH 2010:副语言挑战》将通过解决三个选定的任务,帮助弥合在口语副语言学信息方面的优秀研究和结果的低兼容性之间的差距。“aGender”和“TUM AVIC”语料库是由组织者提供的。第一种包括了由954位说话者构成的长达46小时的电话语音,用于评价那些为了检测说话者的年龄和性别的特征和算法。第二种是关于人类的两小时会话语音记录(21个主题)的特征,注释了5个不同的兴趣水平。语料库通过强制对齐、非语言发声、单注释者轨迹和(次)说话者的顺序,进一步描写了关于一份独特详尽的口语表达的特征,这份口语表达是用词边界的内容来满足的。根据大多数现实生活中设置的需要,这两种都给出关于训练、开发和测试分区的明确定义,并且包含了说话者的独立性。提供了最流行方法的基准测试结果,解决了三个子挑战:

在年龄子挑战中,必须区分出四组儿童、青少年、成人和老年人。

在性别子挑战中,三级分类任务必须区分出女性、男性和儿童。

最后,情感子挑战描写了表现出对顺序感兴趣的相关状态的特征。因此,回归可用于这个任务中。这里,参与者可以通过结合自动语音识别来包括语言特征。为此,训练和开发的录音包括非语言发声是已知的。语境知识是可以使用的,因为“下一个说话者的顺序”是已知的。所有子挑战允许贡献者用自己的分类算法来找到他们自己的特征。然而一个标准特征集是给每个可能使用的语料库准备的。参与者必须坚持训练、开发和测试区分的定义。他们可以报告在开发区分中获得的结果,但是在测试分区中只有两次试验可以上传他们的结果,他们的标签是未知的。使用知名和可获得的进一步的语言资源,例如语音识别,是允许的。下面我们将介绍挑战语料库(第2部分),特征(第3部分),基线(第4部分)和总结(第5部分)。

- 挑战语料库

2.1 aGender

在年龄和性别子挑战中,“aGender”语料库提供了分析和比较。一家外部公司被雇佣来识别可能的目标年龄和性别组的说话者。实验对象收到了有关程序和经济奖励的书面指示。他们被要求给录音系统打六次电话。每次他们都会被自动交互式语音应答系统要求重复给定的语音或者提供免费的内容。说话者获得包含了语音和附加指示的单个提示表单。在每个期间,一天的休息时间被安排好为了确保更多嗓音变化。每个实验对象的六个电话必须在室内和室外交替使用,以获得不同的记录环境。呼叫方通过移动网络或ISDN和PBX连接到记录系统,记录系统是由承载记录应用程序的记录服务器和VoiceXML电话服务器(Genesys语音平台)组成的。语音用8bit,8kHz,A定律存储在应用服务器上。为了验证数据,将相关的年龄群与自己陈述的出生日期的人工录音进行比较。定义了四个年龄组——儿童、青少年、成人和老年人。这种选择不是由任何生理因素激发的,而是由随着年龄的增长嗓音变化引起的,但仅仅从市场方面来看的话阻止了呼叫中心的对话控制应用。由于儿童不被细分为女性和男性,这导致了七个分类,如表1所示。

表1: aGender语料库的年龄和性别分类,x代表了儿童w/o性别区分。

最后两列表示每个分区的说话者/实例的数目(训练和开发)

|

序号 |

组别 |

年龄 性别 |

#训练 #开发 |

|

1 |

儿童 |

7-14 x |

68 / 4 406 38 / 2 396 |

|

2 3 |

青少年 青少年 |

15-24 f 15-24 m |

63 / 4 638 36 / 2 722 55 / 4 019 33 / 2 170 |

|

4 5 |

成人 成人 |

25-54 f 25-54 m |

69 / 4 573 44 / 3 361 66 / 4 417 41 / 2 512 |

|

6 7 |

老年人 老年人 |

55-80 f 55-80 m |

72 / 4 924 51 / 3 561 78 / 5 549 56 / 3 826 |

需要注意的是,由于生日临近语音收集的日期,给定的年龄可能相差一年。并且还有六种情况青少年陈述了一个错误的年龄。尽管如此,(外部)说话者招募人员确信这些n位说话者确实是青少年。

以下要求传达给了被分配到招募说话者任务的公司:从德国联邦各州获得的每个层级至少有100名不能理想均衡德国方言的说德语的人。允许来自一个家庭的多位说话者。阅读给定短语的能力是儿童参与的前提条件。作为进一步的最小要求,我们定义了大小相等的年龄子集群:解释不同年龄间隔的组别,儿童与青少年应在2年内均匀分布,成人与老年人应在5年内均匀分布。比如,这意味着7到8岁的25个儿童和20个17到18岁的年轻女性应该参与。包括儿童组在内的所有年龄组别都应该性别分配均匀。

数据库的内容是以Speech Dat语料库的形式设计的。六个录音期间中的每一个都包含18个发音,这18个发音取自[1]中详细列出的一组发音。这些主题是命令字、嵌入式命令、月份、工作日、相对时间描述、公共假日、出生日期、时间、日期、电话号码、邮政编码、名字、姓氏、是/否,根据自由或者预设的短语和“引发”的问题,比如“请告诉我一个日期,例如一个家庭成员的生日”。

在附带的说明指示上,列出了与特定的会话记录相关的所有内容。在预设的短语中,注意每个说话者的的内容不会重复出现。

总共收集了954位说话者的包含65364个单独语音的长达47个小时的语音集合。需要注意的是,不是每个志愿者都完成了六个电话,还有的情况是一些人被呼叫超过六次,导致每位说话者的所录制的语音数量不同。平均的语音长度是2.58秒。

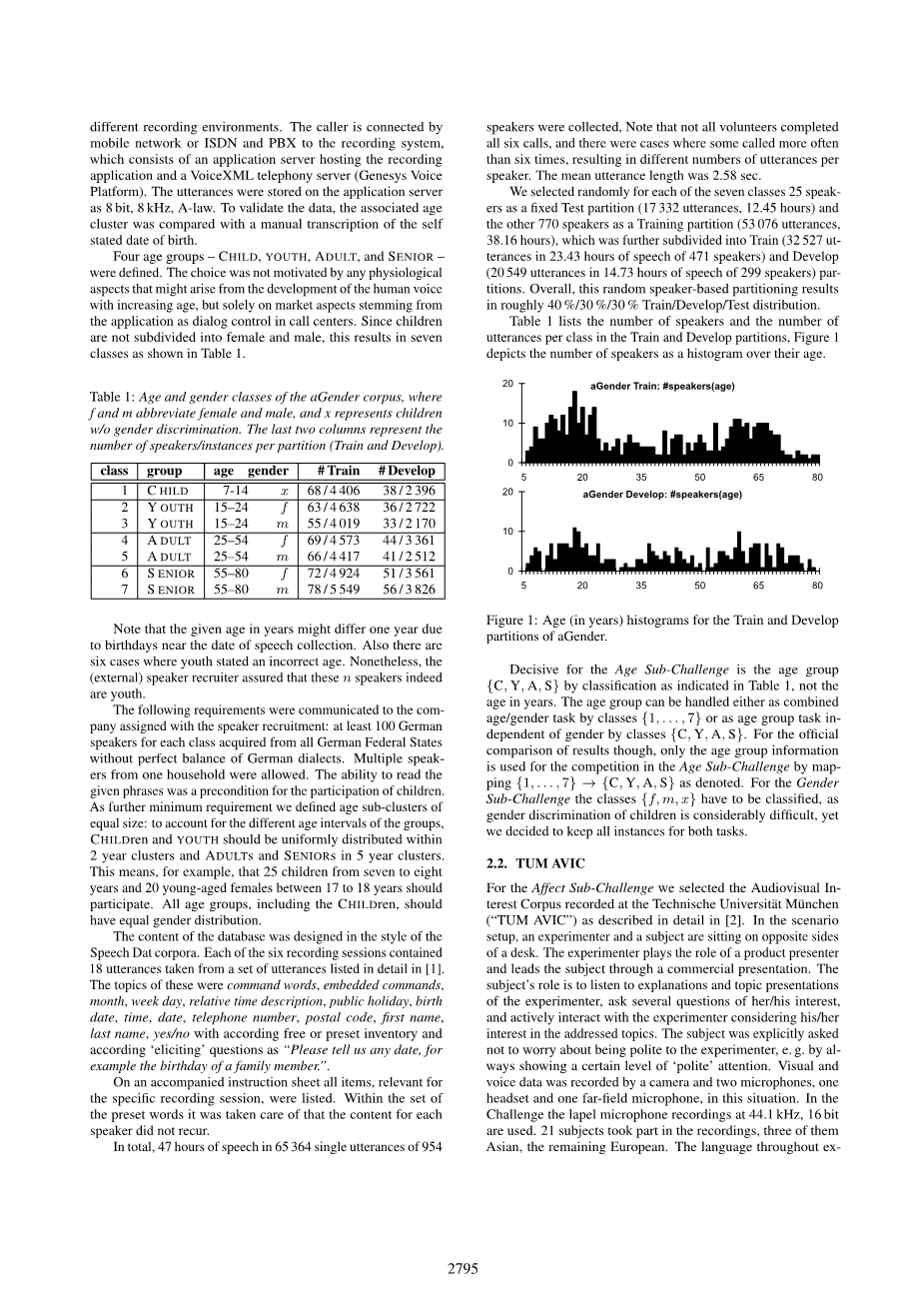

我们随机选择了7个层级中25位说话者作为固定测试分区(17332段语音,12.45小时)和其他770个说话者作为训练分区(53076段语音,38.16小时),进一步细分为训练分区(在471位说话者的23.43小时的32527段语音,)和开发分区(在299位说话者的14.73小时的20549段语音)。总之,这种基于随机说话者的分区导致大约40%/30%/30%的训练/开发/测试分区。

表1列举了说话者和每个组别在训练和开发分区的语音的数目,图1描述了说话者根据年龄分布的数量直方图。

图1:aGender的训练和开发分区的的年龄直方图

年龄子挑战的决定性因素是按表1所示分类的年龄组{C,Y,A,S},而不是以年为单位。年龄组可以按类{1,...,7}作为年龄/性别联合任务处理,也可以按类{C,Y,A,S}作为与性别无关的年龄组任务处理。但是对于结果的官方比较,在年龄子挑战通过映射{1,...,7}→{C,Y,A,S}作为指示,只有年龄组信息被用来竞争。对于性别子挑战来说,必须区分出{f,m,x},因为儿童的性别区分相当困难,但是我们决定保留所有的实例来完成两个任务。

2.2 TUM AVIC

对于情感子挑战,我们选择了在Technische Universitauml;t Muuml;nchen记录的Audiovisual Interest Corpus(“TUM AVIC”) ,详见[2]。在场景设置中,实验者和实验对象分别坐在桌子的相对两侧。实验者扮演产品推销者的角色,并且通过商业演示引导实验对象。实验对象的角色就是聆听实验者的解释和主题陈述,问几个他/她感兴趣的问题,并且根据他/她对演讲主题的兴趣,积极与实验者互动。实验对象被明确要求不用担心对实验者表现出礼貌,例如总是表现出一定程度的“礼貌”关怀。在这个情境中,通过一台照相机和一个头戴式麦克风一个远场麦克风记录视觉和语音数据。在挑战中,佩戴式麦克风录音使用的是44.1kHz和16bit。21位实验对象参加了录音,其中3位是亚洲人,其余的是欧洲人。整个实验使用的是英语,而且对所有的实验对象来说英语都不是母语,而是熟练使用而已。更多关于实验对象的细节总结在表2中。

表2: 关于TUM AVIC数据库中的实验对象的详细信息。文章中的进一步细节

|

组别 |

#实验对象 平均年龄 记录时长(小时) |

|

所有 |

21 29.9 10:22:30 |

|

男性 女性 |

11 29.7 5:14:30 10 30.1 5:08:00 |

|

年龄lt;30 年龄30-40 年龄gt;40 |

11 23.4 5:13:10 7 32.0 3:37:50 3 47.7 1:31:30 |

为了获得实验对象的“兴趣水平”(LOI)的可靠标签,整个视频材料被分割成说话者和下一个说话者的顺序,随后由四个男性注释者独立标记。四位注释者是心理学专业的本科生。目的是在常识上注释观察到的兴趣。说话人顺序被定义为仅由一个说话人产生的连续语音片段——回声道感叹(“mhm”等)被忽略,换言之就是每次说话人发生变化,就是一个新的说话者的顺序。这与“顺序”这一术语的共同理解是一致的。因此,说话者可以包含多个,特别是长句。为了在更精细的时间尺度上提供兴趣等级分析,在语法短语边界处进一步分割说话者顺序:通过标点符号和句法和语法规则分割持续时间超过

剩余内容已隐藏,支付完成后下载完整资料

资料编号:[18433],资料为PDF文档或Word文档,PDF文档可免费转换为Word