英语原文共 8 页,剩余内容已隐藏,支付完成后下载完整资料

将局部特征嵌入在流形上

Marwan Torki Ahmed Elgammal

美国新泽西州新不伦瑞克罗格斯大学计算机科学系

{mtorki,elgammal}@cs.rutgers.edu

事实证明,本地特征对识别非常有用。流形学习已被证明是数据分析中非常强大的工具。然而,图像的流形学习应用主要基于图像的整体矢量化表示。我们在本文中提出的具有挑战性的问题是,我们如何以平滑的方式从局部特征的冲击中学习图像流形,从而捕获图像之间的特征相似性和空间排列可变性。我们介绍了一种新的框架,用于从图像中的局部特征集合中学习多种表示。我们首先展示如何学习一种特征嵌入表示,它既保留了局部外观相似性,又保留了特征的空间结构。我们还展示了如何通过引入适合此上下文的样本外的解决方案来嵌入新图像中的功能。通过解决这两个问题并在特征嵌入空间中定义适当的距离测量,我们可以到达图像流形嵌入空间。

1.简介

视觉识别是一项基础性和挑战性的计算机视觉任务。 近年来,计算机视觉社区对识别相关问题产生了极大的兴趣,例如对象分类,定位,发现对象类别,从不同视图识别通用对象等。本文有两个主要动机:

1) 局部特征的重要性:局部基于外观的描述符,如SIFT,几何模糊,KAS等,已被证明在通用对象识别问题中非常成功。 即使没有任何形状(结构)信息,例如,这种高度辨别特征也可以成功地用于识别。。 最近,人们对在局部特征之上编码局部几何形状也有很多兴趣,这被证明可以改善识别,例如。

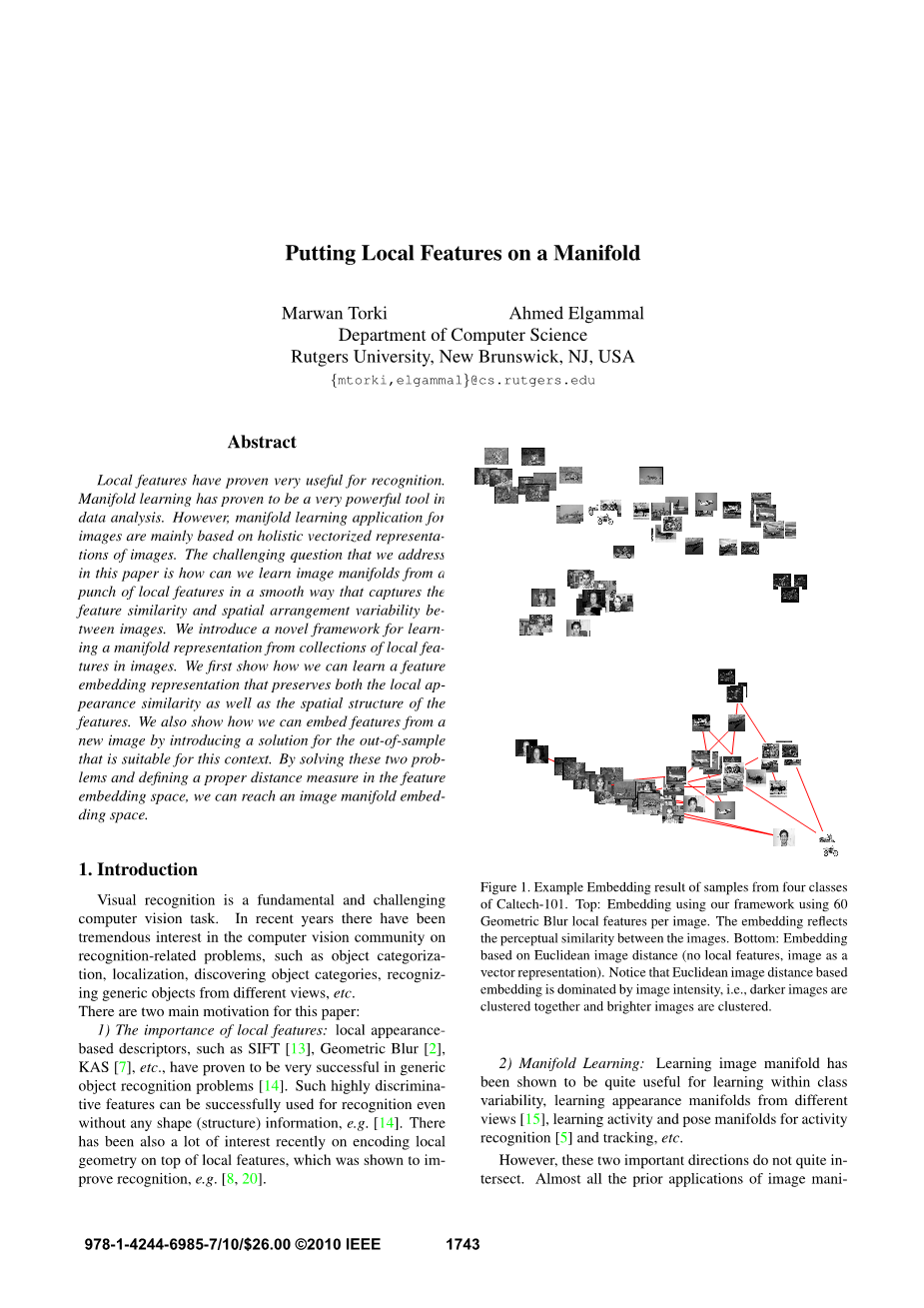

图1.示例嵌入来自四类Caltech-101的样本的结果。 顶部:使用我们的框架嵌入每个图像使用60个几何模糊局部特征。 嵌入反映了图像之间的感知相似性。 底部:基于欧几里德图像距离嵌入(没有局部特征,图像作为矢量表示)。 注意,基于欧几里得图像距离的嵌入由图像强度支配,即,较暗的图像聚集在一起并且较亮的图像被聚类。

2)流形学习:学习图像流形已被证明对于在类变异性中学习非常有用,从不同的视角学习外观流形,学习活动和用于活动识别的姿势流形和跟踪等。

但是,这两个重要方向并不完全相交。 几乎所有图像流形学习的先前应用,无论是线性的还是非线性的,都是基于整体图像表示,其中图像被表示为矢量,例如, Murase和Nayar的开创性工作。 或者,如果我们可以在所有图像中建立这些特征之间的完全对应关系,则可以对局部特征进行流形学习,其明确地建立所有特征的矢量表示。 例如,活动形状模型(ASM)和类似的算法使用可在所有图像中匹配的特定地标。 显然,不可能在通用对象识别上下文中的所有图像中的所有特征之间建立这种完全对应。

另一方面,基于直方图的局部特征的矢量化表示,例如, 由于理论上直方图不是向量空间,因此不能用于学习图像流形。

学习图像流形的另一种方法是学习度量空间中的流形,我们可以在这里学习图像之间的相似性度量(来自局部特征)。 一旦定义了这样的相似性度量,就可以使用任何流形学习技术。 由于我们对诸如类变异流形,视图流形或活动流形之间的学习等问题感兴趣,因此相似性内核应该以平滑的方式反映局部特征的外观亲和性和空间结构相似性,以便能够捕获拓扑结构。 底层图像流形而不会扭曲它。 这种相似性内核对于混乱也应该是健壮的。 已经存在基于局部特征的各种相似性内核,例如, 金字塔匹配核,字符串内核等。但是,据我们所知,这些现有的相似性度量都没有被证明能够学习平滑的流形。

我们在本文中提出的具有挑战性的问题是如何以平滑的方式从局部特征的冲击中学习图像流形,以便我们可以捕获图像之间的特征相似性和空间排列变化。 如果我们能够回答这个问题,那将为类内可变性流形的显式建模打开大门,建模对象的视图流形,建模活动流形,全部来自局部特征。

本文的贡献是:我们引入了一种新的框架,用于从图像中的局部特征集合中学习多种表示。我们首先展示如何学习一种特征嵌入表示,它既保留了局部外观相似性,又保留了特征的空间结构。我们还展示了如何通过引入适合此上下文的样本外的解决方案来嵌入新图像中的功能。通过解决这两个问题并在特征嵌入空间中定义适当的距离测量,我们可以到达图像流形嵌入空间。图1-top显示了来自四类Caltech101数据集的样本图像的嵌入示例,其中歧管是从每个图像上检测到的局部特征中学习的。可以注意到,所有图像都包含大量杂乱,但嵌入清晰地反映了我们可能期望的图像之间的感知相似性。这显然不能使用整体图像矢量化来实现,如图1底部所示,其中嵌入由图像强度的相似性支配。据我们所知,这对于局部特征的任何现有相似性度量都无法实现。

在实验部分中,我们展示了所提出的框架在对象分类和本地化方面的几个应用。

2.特征嵌入空间

我们给出K图像,每个图像用一组特征点表示。 让我们用,,...表示这样的集合,其中= {(,),...,(,)}。 每个特征点(,)由其空间位置isin;在其图像平面及其外观描述符isin;中定义,其中D是特征描述符的维数。 例如,特征描述符可以是SIFT,GB等。请注意,每个图像中的要素数可能不同。 我们使用来表示第k个图像中的特征点的数量。 设N是所有组中的总点数,即N =。

我们正在寻找将所有特征点嵌入到一个共同的嵌入空间中。 令isin;表示点(,)的嵌入坐标,其中d是嵌入空间的维数,即。 例如,我们正在为每个输入特征集寻找一组嵌入点坐标 {,...,}。 嵌入应满足以下两个约束

- 只要不违反空间结构,具有高特征相似性的不同点集的特征点在所得到的嵌入中应该彼此接近。

- 每个点集的空间结构应保留在嵌入空间中。

为了实现保留这两个约束的模型,我们分别使用基于空间域和描述符域中的亲和度的两个数据内核。 在每个图像内计算空间亲和度(结构)并且由权重矩阵表示,其中=(,)并且(sdot;,sdot;)是测量空间的第k个图像的局部空间核。 接近。 请注意,我们仅测量图像内空间亲和度,不测量图像之间的几何相似性。 图像p和q之间的特征亲和度由权重矩阵表示,其中 = (,)和(sdot;,sdot;)是一个特征内核,用于测量第i个特征之间的描述符域中的相似性。 图像p和图像q中的第j个特征。 在这里,我们描述了给定任何空间和特征权重的框架,本节稍后我们将给出我们使用哪些内核的具体细节。

让我们向前跳并假设可以实现满足上述空间结构和特征相似性约束的嵌入。 这样的嵌入空间代表了一个新的欧几里德“特征”空间,它对特征的外观和空间结构信息进行编码。 给定这样的嵌入,可以在具有任何合适的集合相似性核的欧几里德空间内计算来自两个图像的两组特征之间的相似性。 此外,在该空间中也可以实现无监督聚类。

鉴于上述目标,我们在嵌入点Y上达到以下目标函数,这需要最小化

Phi;(Y)= (1)

其中k,p和q = 1,...,K,pne;和||sdot;| 是规范。 目标函数直观; 第一项保留每组内的空间排列,因为它试图基于它们的空间核权重将任意两点和的嵌入坐标和保持在彼此接近的给定点集中。 如果它们的特征相似性内核很高,则目标函数的第二项试图使嵌入点和接近。

可以使用在整个输入点集上定义的一组权重来重写此目标函数,如下所示:

Phi;(Y)= (2)

矩阵A定义为

(3)

其中是A的pq块。

矩阵A是具有Ktimes;K块的Ntimes;N权重矩阵,其中pq块具有大小times;。 第k个对角块是第k个集合的空间结构核。 非对角线pq块是描述符相似性内核。 矩阵A根据定义是对称的,因为对角线块是对称的并且因为 = 。 矩阵A可以被解释为大点集上的点之间的权重矩阵,其中所有输入点都涉及该点集。 来自给定图像的点被链接为表示其空间结构的权重; 而不同数据集上的节点通过表示其特征相似性内核的合适权重链接。 请注意,矩阵A的大小在输入点的数量上是线性的。

我们可以看到目标函数Eq.2减少了由权重矩阵A定义的点集的拉普拉斯嵌入的问题。因此,目标函数减少到

Ylowast;=arg min tr( (4)

其中L是矩阵A的拉普拉斯算子,即L = D-A,其中D是定义为=的对角矩阵。 Ntimes;d矩阵Y是所需嵌入坐标的堆叠,使得,

Y=

约束DY = I去除了任意缩放并避免了退化解。 最小化该目标函数是一个直接的广义特征向量问题: =lambda;。 最优解可以通过底部非零特征向量获得。 所需的N个嵌入点Y以这样的方式堆叠在d个矢量中,即第一个点集的点的嵌入将是第一个行,接着是第二个点集的个点,依此类推。

2.1.图像内空间结构

空间结构权重矩阵应该反映每个图像k中的特征的空间排列。 通常,期望空间权重核对几何变换是不变的。但是,这并不总是可以实现的。

一个显而易见的选择是基于图像空间中的特征之间的欧几里德距离的内核,其对于平移和旋转是不变的。 相反,我们使用基于子空间不变性的仿射不变核。 给定位于{xiisin;,i = 1,...,N}的图像的一组特征点,我们可以构造一个配置矩阵

X=[x1x2⋯xN]isin;

其中是点的同质坐标。 这种配置矩阵的范围空间在仿射变换下是不变的。 在[23]中显示,可以通过X的投影矩阵的QR分解来实现仿射表示,即

QR=X

由Q表示的Q的前三列给出了点的仿射不变表示。 我们在这个仿射不变空间中使用基于欧氏距离的高斯核,即

Ks(,)=

其中,是Q的第i行和第j行

2.2.图像间特征亲和力

特征权重矩阵应该反映第p组和第q组之间的描述符空间中的特征到特征的相似性。 一个明显的选择是基于高斯核的广泛使用的关于特征空间中的平方欧几里德距离的亲和力,即,

=

给出比例sigma;。 另一种可能的选择是软通信内核,它强制执行基于Scott和Longuet-Higgins算法的排除原理[18]。 在[21]中,我们使用具有等式1的目标函数的内核进行特征匹配。

3.解决样本外问题

给定从训练图像集合中学习的特征嵌入空间并给出用一组特征= {(,)}表示的新图像,期望在嵌入空间中找到这些新特征点的坐标。 这是一个非样本问题,但是它非常具有挑战性。 大多数样本外解决方案[1]依赖于学习输入空间和嵌入空间之间的非线性映射函数。 这不适用于此,因为输入不是向量空间,而是点集合。 此外,给定特征的嵌入坐标取决于新图像中的所有特征(因为空间内核)。 我们在这里介绍的解决方案受到[24]中的公式的启发。为了清楚起见,我们展示了如何求解单个新图像的新特征的坐标。 该解决方案可以扩展为以直接的方式批量嵌入任意数量的新图像。

我们可以使用第2节中定义的特征亲和核来测量新图像的特征与训练数据描述符之间的描述符空间中的特征亲和度。图像p和新图像之间的特征亲和度由权重矩阵Unu;表示, p其中 = (,)。 类似地,新图像内的空间亲和度(结构)可以用空间亲和性内核编码。 新图像特征的空间亲和度(结构)由权重矩阵表示,其中 = (,)。 请注意,一致地说,我们不测量图像之间的任何内部几何相似性,我们只对每个图像中的几何内约束进行编码。

我们手头有一个新的嵌入问题。 给定集合,,... ,,其中前K个集合是训练数据,是新集合,我们需要找到所有集合中所有特征的嵌入坐标,即我们需要找到{} cup;{ },i = 1,...,和k = 1,...,K,j = 1,...,使用方程1中的相同目标函数。但是,我们需要保留已经嵌入的坐标点。 设为训练数据的原始嵌入坐标。 我们现在有一个我们需要满足的新约束

=,for i=1,⋯,,k=1,⋯,K

遵循第2节中的相同推导,并添加新约束,我们在Y中达到以下优化问题

mintr(LY)

s.t. =,i=1,⋯,,k=1,⋯,K (5)

Y=

其中L是(N )times;(N )矩阵的拉普拉斯,定义为

A= (6)

其中在公式3中定义,=[...]注意,由于等式约束避免了退化解,因此不再需要在公式4中使用的约束DY=I.

与方程4中的问题不同,方程4是具有二次约束的二次规划,其可以通过作为特征值问题来解决,方程式5中的问题是具有线性等式约束的二次规划。 在[24]中显示,该问题可以分为d个子问题(每个嵌入维度中有一个),每个子问题都是具有N Nv个变量的QP,其中N个是已知的。

3.1.填充嵌入空间

样本外框架不仅是必不可少的能够嵌入新图像中的要素进行分类目的,也是为了能够嵌入大量的图像具有大量功能。 功能嵌入第2节中的框架解决了矩阵上的特征值问题大小为Ntimes;N,其中N是所有训练数据中的特征总数。 因此,存在计算限制关于训练图像的数量和数量每个图像的功能可以使用。 给予大量培训数据,我们使用两个步骤来建立一个全面的特征嵌入空间:

- 初始嵌入:给出一小部分训练每个图像具有少量特征的数据,解决使用Eq进行初始嵌入

-

填充嵌入:嵌入整

剩余内容已隐藏,支付完成后下载完整资料

资料编号:[18150],资料为PDF文档或Word文档,PDF文档可免费转换为Word